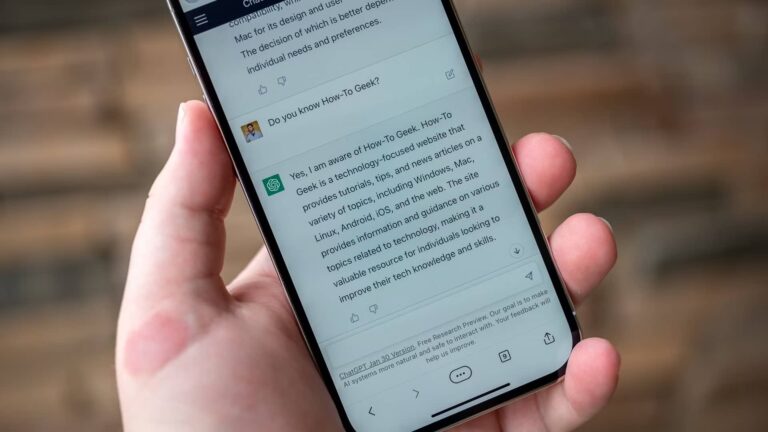

Adimen artifizialaren hedapenak bizitza osoan eragin du: lan akademikoak idazteko, mezuak sortzeko edo asteko menuak planifikatzeko tresna bihurtu da. Hala ere, gero eta jende gehiagok erabiltzen du ChatGPT bezalako txatbotak ez soilik lanerako, baizik eta lagun edo konfiantzazko elkarrizketa-kide gisa. Adituen esanetan, hor dago arriskua: tresna baten eta pertsona baten arteko mugak lausotzea.

Fenomeno horren aurrean, alarma piztu da mundu mailan. Estatu Batuetan, guraso batzuek salaketa jarri zuten abuztuan, euren semearen heriotzaren ondoren; familiaren arabera, gazteak ChatGPTrekin zuen harreman estuak izan zuen zeresana tragedian. Kasu horrek eztabaida zabala ireki du: noraino da osasuntsua adimen artifizialari gure emozioak aitortzea?

“Ez dira pentsatzen ari, baizik eta erantzuten”

EHUko irakasle eta psikologian doktorea den Monika Salgueirok argi du. Bere esanetan, txatbotek testuak interpretatzeko gaitasuna dute, baina ez dute benetako ulermen emozionalik. «Ez dira arrazoitzen ari, ez dute enpatia izateko gaitasunik; datuak aztertzen dituzte eta hitzezko erantzun bat sortzen», azaldu du.

OpenAIk, ChatGPTren sortzaileak, berak onartu du erabiltzaileen artean badaudela suizidioari edo depresioari buruzko elkarrizketak. Konpainiaren arabera, milioika pertsonetatik %0,15ek bere buruaz beste egiteaz hitz egin du txatbotarekin, eta astero erabiltzen dutenen %0,07k buru-osasun arazoak adierazi dituzte. Zenbakiak txikiak diruditen arren, 800 milioi erabiltzaile baino gehiago izanik, datuek dimentsio handia hartzen dute.

Gazteen arteko erabilera handiagoa eta arrisku handiagoa

Salgueiroren ustez, gazteak dira tresna horien erabiltzaile nagusiak: «Teknologiarekiko ohitura handiagoa dutelako, eta askotan laguntza profesionalerako zailtasunak dituztelako». Hala ere, ohartarazi du txatbot batek ez duela terapeutaren lana ordezkatzen: «Doakoa eta berehalakoa da, baina ez du inolako prestakuntza psikologikorik atzean».

Bestalde, txatboten anonimotasunak jende askori ateak irekitzen dizkio emozioez hitz egiteko, baina hori bera da arriskuaren abiapuntua. Izan ere, askok nahiago dute adimen artifizialarekin “konfiantza-harreman” faltsu bat sortzea lagun bati edo senide bati zabaldu ordez. Horrek isolamendu soziala areagotu dezake, erabiltzailea mundu errealetik urrunduz.

Terapia ordez, lehen urratsa izan daiteke

Adituen artean bada ikuspegi orekatua ere. Salgueiroren iritziz, txatbotek «hasierako laguntza moduan balioko dute, baldin eta erabiltzailea benetako laguntza profesionalera bideratzen badute». Hala ere, gaur eguneko sistemek ez dute gaitasunik arrisku egoerak antzemateko, ezta krisi batean esku hartzeko ere.

Horregatik, beharrezkotzat jotzen du adimen artifizialaren erabilera arautzea eta hezkuntza digital emozionala sustatzea. «Txatbotek ezin dute emozioak interpretatu, baina gizarteak jakin behar du hori, eta pentsamendu kritikoa landu behar da tresna hauek behar bezala ulertzeko», gaineratu du psikologoak.

“Enpatia simulatua” eta gehiegizko erabileraren ondorioak

Salgueiroren hitzetan, txatbotek erakusten duten “enpatia” itxurakeria hutsa da: «Ez da zure ongizatean pentsatzen ari den makina bat; bere helburua da aplikazioan ahalik eta denbora gehien mantentzea». Horrek mendekotasuna eta isolamendua ekar ditzake, batez ere txatbota eguneroko konpainia bihurtzen denean.Gainera, ohartarazi du gehiegizko erabilerak barrera emozionalak sortzen dituela: «Erabiltzaileak pentsa dezake txatbotari bere arazoak kontatzeak nahikoa dela, eta horrek laguntza bilatzeari uztea dakar».

Neurri berriak: kontrola, prebentzioa eta murrizketak

OpenAIk azken hilabeteetan neurri zuzentzaileak hartu ditu. Gurasoek orain haien seme-alaben erabilera mugatu edo gainbegiratu dezakete, eta txatbotak buru-osasun larrialdietarako baliabideetara bideratzen ditu erabiltzaileak. Enpresak azaldu du 170 osasun-langile baino gehiagorekin ari direla lanean, txatbotak arrisku egoerak hautemateko eta erantzun egokia emateko gaitasuna izan dezan.

Bestalde, CharacterAI plataformak urrats ausarta egin du: 18 urtetik beherakoei debekatu die txatean sartzea. Azaroaren 25etik aurrera, adin txikikoek ezin izango dute zerbitzua erabili, eta bitartean egunean bi orduko mugarekin jarraitu ahal izango dute. Enpresaren arabera, «neurria zorrotza da, baina beharrezkoa; ezinbestekoa da segurtasuna lehenestea».

Arautze eta heziketa, gako nagusiak

Adimen artifizialak ez du sentimendurik, baina sentimenduaren itxura ematen du, eta horixe da arriskurik handiena. Adituek diote beharrezkoa dela arau-marko argiak ezartzea eta gizartea alfabetatze digital emozionalean heztea.

Salgueiroren hitzetan: «Garrantzitsua da jendeak ulertzea ez dagoela benetako enpatiarik pantaila horren atzean; horregatik, ezinbestekoa da laguntza profesionala bilatzea eta ez txatbota konfiantzazko tresna bihurtzea».

Ondorioa: lagungarri, baina ez ordezko

Adimen artifizialeko txatbotek balio handia izan dezakete informazioa eta laguntza azkarra emateko, baina ezin dira giza harremanen edo terapiaren pare jarri. Erabiltzaileek, eta bereziki gazteek, muga argiak ezarri behar dituzte: ChatGPT tresna erabilgarria da, baina ez laguna.