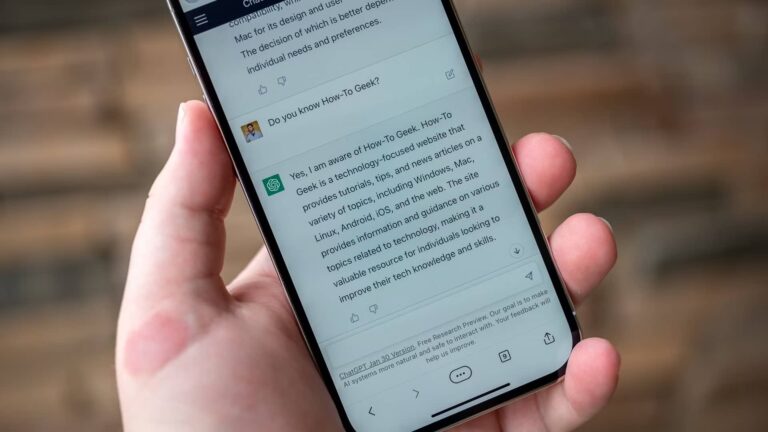

Adimen Artifiziala, eta bereziki ChatGPT bezalako tresnak, gero eta gehiago erabiltzen dira eguneroko bizitzako hainbat jardueratan. Hala ere, garrantzitsua da kontuan hartzea zer informazio partekatzen dugun, izan daitekeen arriskuez jabetzeko eta gure datuak babesteko.

Laguntzaile erabilgarria… baina arrisku potentzialekin

Eskolako lanak idazteko, informazioa bilatzeko, aholku profesionalak jasotzeko edo osasunari buruzko kontsultak egiteko erabiltzen da gaur egun ChatGPT. Hala ere, erabiltzaile askok ez dute jabetzen sistema hauek jasotzen duten informazioa prozesatu eta, batzuetan, gordetzen dutela. Hori dela eta, erabiltzailearen inguruko xehetasun ugari pilatu daitezke erantzunak pertsonalizatzeko helburuarekin.

Adituek abisua eman dute: kontuz datu hauekin

Adituek ohartarazi dute badirela ChatGPT bezalako tresnekin inoiz partekatu behar ez diren datu batzuk, izan ere, informazio horrek erabilera okerra izan dezake eta zibererasoen ateak zabaldu. Hauek dira datu sentikorrenetako batzuk:

- Datu pertsonalak: Ez sartu NANa, pasaportearen zenbakia, helbideak, telefono zenbakiak edo jaiotza data.

- Osasun-datuak: Ez partekatu proba medikoen emaitzarik, are gutxiago identifikazio-datuak tartean badira.

- Finantza-informazioa: Ez idatzi kontu korronteen zenbakiak, kreditu-txartelak edo inbertsioen xehetasunak.

- Laneko informazioa: Saihestu zure enpresako barne-informazioa partekatzea (proiektuak, estrategiak, kodeak…).

- Pasahitzak eta erabiltzaile izenak: Ez erabili txatbotak zure sarbide-datuen biltegi gisa.

Zentzuzko erabilera: prebentzioa da gakoa

Zure pribatutasuna bermatzeko, komenigarria da behin-behineko txatak erabiltzea edo elkarrizketak ezabatzea amaitutakoan. Dena den, funtsezkoa da beti zentzuz eta arduraz jokatzea. Izan ere, adimen artifizialak laguntza eskaini dezake, baina arriskuak ere baditu, eta erabiltzaileen ardura da horiek murriztea.